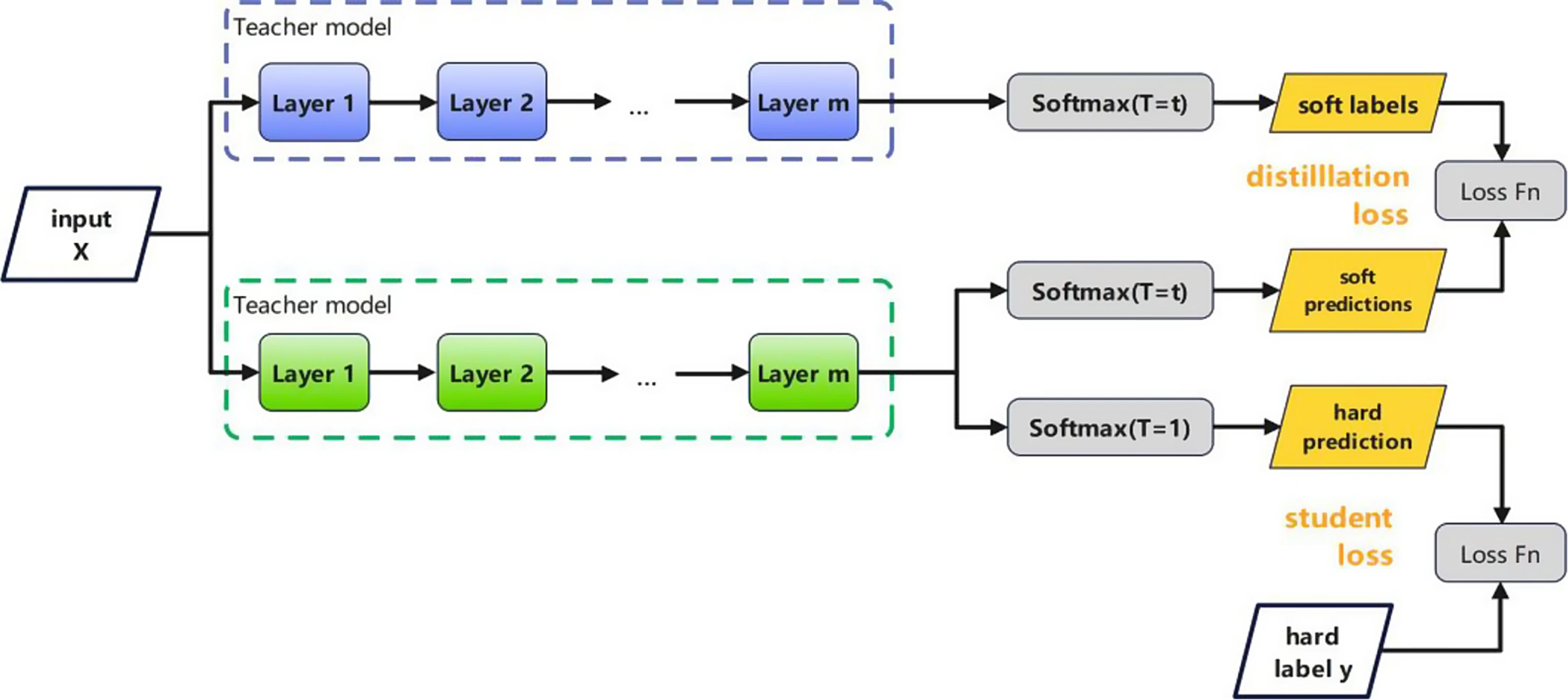

概念 “模型蒸馏”(Model Distillation)是一种高效的模型压缩与知识转移方法,其通常会使用一个已经经过训练的教师模型,该模型在大型数据集上表现出色。然后,将教师模型的知识传递给一个更小的学生模型,使得学生模型能够以较小的规模进行推理,并保持与教师模型相似的性能。 教师模型 教师模型是指一个已经训练好的、容量大、性能强的模型。它的作用是在蒸馏过程中提供预测概率(soft label),指导学生模型的学习。 为什么蒸馏比直接训练小模型效果好? 标签(Hard Label) 教师模型预测(Soft Lab…

前言 内网穿透有多种方法,包括使用frp的中转以及zerotier的握手。 使用zerotier进行内网穿透相较于frp的中转,其安全性更高(可不使用域名或公网IP)同时当连接建立成功其连接速度也比frp的快(frp受限于中转服务器的上传下载),具体原理可参考B站视频:BV1ShqBYdEDC ZeroTier注册及网页使用 通过ZeroTier主页进行注册,目前(2025年4月2日)免费版能够创建3个虚拟组网,并且总共能够添加10个设备(3个组网一共10个设备,未授权设备不占用设备额度)。 按以下顺序依次进行,到…

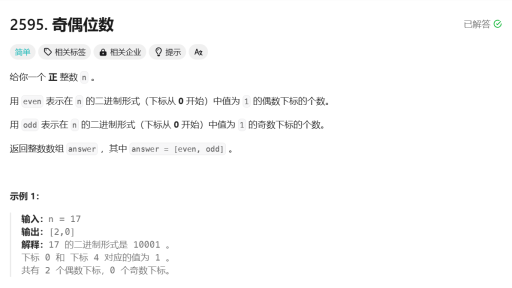

【每日一题】Leetcode 2595. 奇偶位数 ——跳转原题 简单 位运算 给你一个 正 整数 n 。 用 even 表示在 n 的二进制形式(下标从 0 开始)中值为 1 的偶数下标的个数。 用 odd 表示在 n 的二进制形式(下标从 0 开始)中值为 1 的奇数下标的个数。 返回整数数组 answer ,其中 answer = [even, odd] 。 示例 1: 输入:n = 17 输出:[2,0] 解释:17 的二进制形式是 10001 。 下标 0 和 下标 4 对应的值为 1 。 共有 2 个偶…

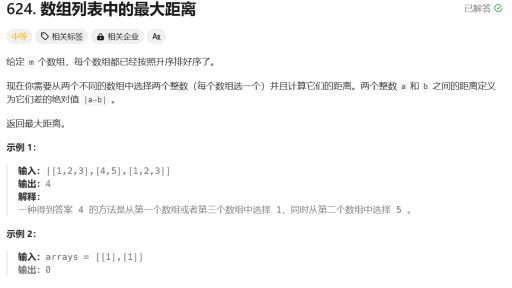

【每日一题】Leetcode 624. 数组列表中的最大距离 ——跳转原题 中等 贪心 数组 给定 m 个数组,每个数组都已经按照升序排好序了。 现在你需要从两个不同的数组中选择两个整数(每个数组选一个)并且计算它们的距离。两个整数 a 和 b 之间的距离定义为它们差的绝对值 |a-b| 。 返回最大距离。 示例 1: 输入:[[1,2,3],[4,5],[1,2,3]] 输出:4 解释: 一种得到答案 4 的方法是从第一个数组或者第三个数组中选择 1,同时从第二个数组中选择 5 。 示例 2: 输入:arrays…

【每日一题】Leetcode 2080. 区间内查询数字的频率 ——跳转原题 中等 设计 线段树 数组 哈希表 二分查找 请你设计一个数据结构,它能求出给定子数组内一个给定值的 频率 。 子数组中一个值的 频率 指的是这个子数组中这个值的出现次数。 请你实现 RangeFreqQuery 类: RangeFreqQuery(int[] arr) 用下标从 0 开始的整数数组 arr 构造一个类的实例。 int query(int left, int right, int value) 返回子数组 arr[left.…

【每日一题】Leetcode 1287. 有序数组中出现次数超过25%的元素 ——跳转原题 简单 数组 二分查找 给你一个非递减的 有序 整数数组,已知这个数组中恰好有一个整数,它的出现次数超过数组元素总数的 25%。 请你找到并返回这个整数 示例: 输入:arr = [1,2,2,6,6,6,6,7,10] 输出:6 提示: 1 <= arr.length <= 10^4 0 <= arr[i] <= 10^5 隐藏信息:1. 有且仅有一个答案;2. 必有一个答案 思路 1:(遍历,时间复…

【每日一题】Leetcode 1299. 将每个元素替换为右侧最大元素 ——跳转原题 简单 数组 逆序遍历 给你一个数组 arr ,请你将每个元素用它右边最大的元素替换,如果是最后一个元素,用 -1 替换。 完成所有替换操作后,请你返回这个数组。 示例 1: 输入:arr = [17,18,5,4,6,1] 输出:[18,6,6,6,1,-1] 解释: - 下标 0 的元素 --> 右侧最大元素是下标 1 的元素 (18) - 下标 1 的元素 --> 右侧最大元素是下标 4 的元素 (6) - 下标 …

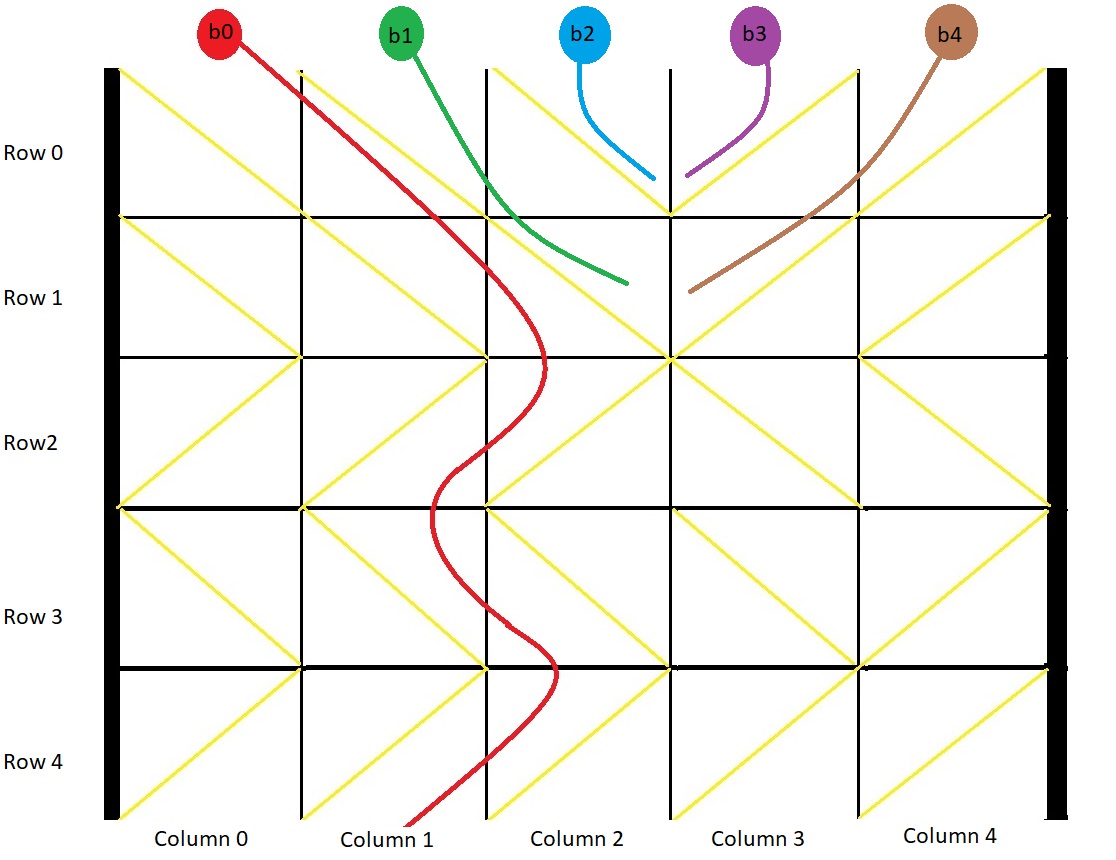

【每日一题】Leetcode 1706. 球会落何处 ——跳转原题 中等 数组 矩阵 模拟 用一个大小为 m x n 的二维网格 grid 表示一个箱子。你有 n 颗球。箱子的顶部和底部都是开着的。 箱子中的每个单元格都有一个对角线挡板,跨过单元格的两个角,可以将球导向左侧或者右侧。 将球导向右侧的挡板跨过左上角和右下角,在网格中用 1 表示。 将球导向左侧的挡板跨过右上角和左下角,在网格中用 -1 表示。 在箱子每一列的顶端各放一颗球。每颗球都可能卡在箱子里或从底部掉出来。如果球恰好卡在两块挡板之间的 "…

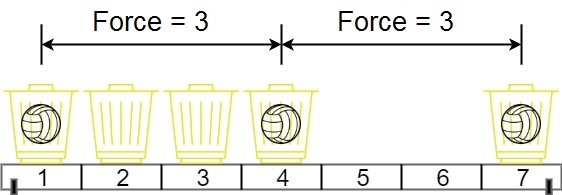

【每日一题】Leetcode 1552. 两球之间的磁力 ——跳转原题 中等 数组 二分查找 排序 在代号为 C-137 的地球上,Rick 发现如果他将两个球放在他新发明的篮子里,它们之间会形成特殊形式的磁力。Rick 有 n 个空的篮子,第 i 个篮子的位置在 position[i] ,Morty 想把 m 个球放到这些篮子里,使得任意两球间 最小磁力 最大。 已知两个球如果分别位于 x 和 y ,那么它们之间的磁力为 |x - y| 。 给你一个整数数组 position 和一个整数 m ,请你返回最大化的最…

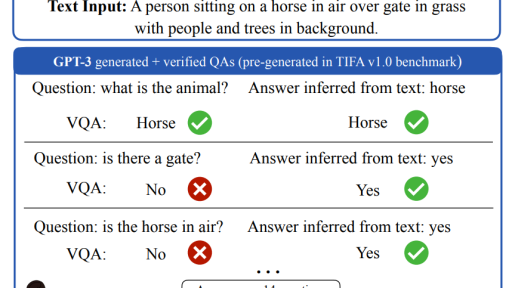

本文介绍了一种新的文本到图像生成模型(Text-Image Generative Models)的评估方法,其采用了VQA来衡量生成图像与其文本输入之间的忠实度,可以从更细粒度的层面评估文本图像生成模型的性能,例如颜色、数量以及组合关系。 Abstract 尽管成千上万的研究人员、工程师和艺术家积极致力于改进文本到图像生成模型,但系统通常无法生成与文本输入准确一致的图像。我们引入了 TIFA(带问答的文本到图像忠实度评估),这是一种自动评估指标,它通过视觉问答 (VQA) 来衡量生成的图像与其文本输入的忠实度。具体…