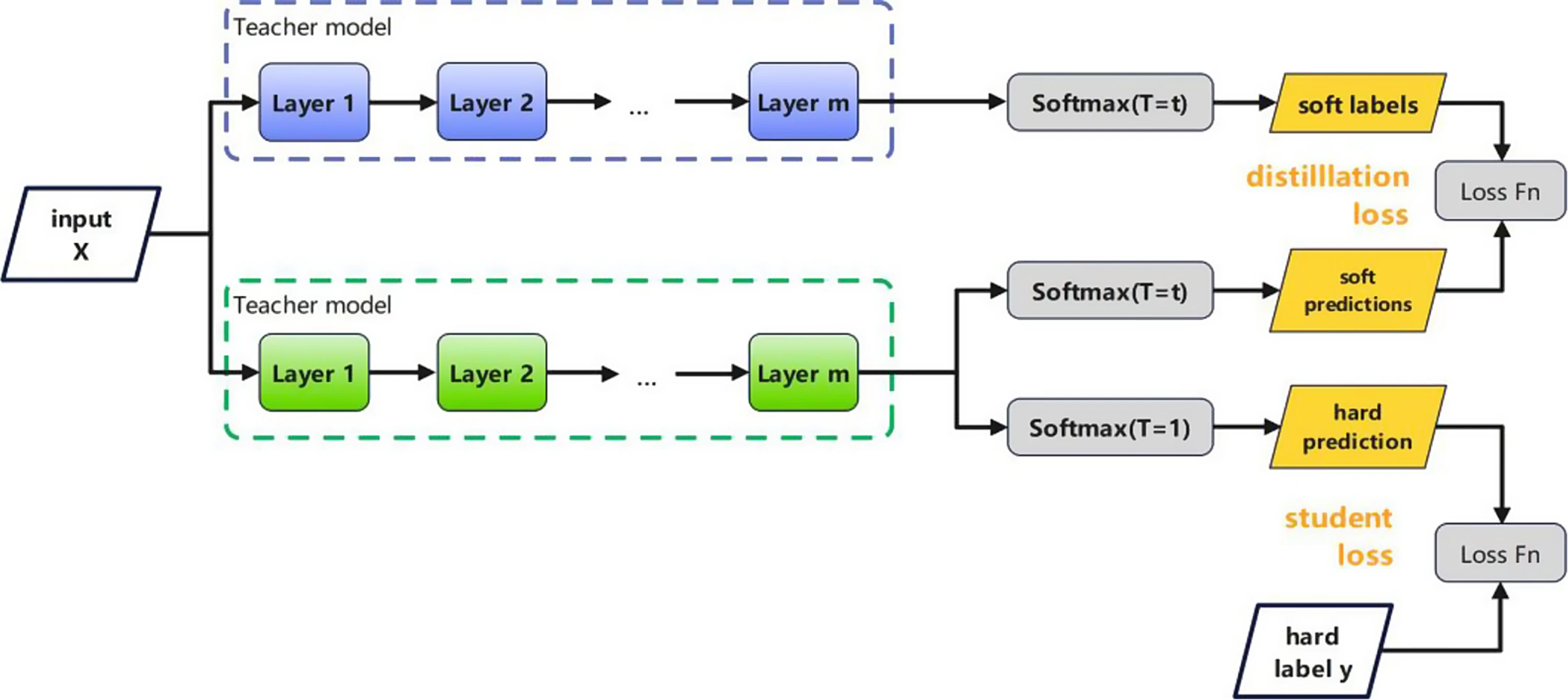

概念 “模型蒸馏”(Model Distillation)是一种高效的模型压缩与知识转移方法,其通常会使用一个已经经过训练的教师模型,该模型在大型数据集上表现出色。然后,将教师模型的知识传递给一个更小的学生模型,使得学生模型能够以较小的规模进行推理,并保持与教师模型相似的性能。 教师模型 教师模型是指一个已经训练好的、容量大、性能强的模型。它的作用是在蒸馏过程中提供预测概率(soft label),指导学生模型的学习。 为什么蒸馏比直接训练小模型效果好? 标签(Hard Label) 教师模型预测(Soft Lab…